皆様、お疲れ様です!元気にしていますでしょうか?

現代社会は、便利で刺激的な一方で、私たちの心には複雑な影を落とすことも少なくありません。特に「鬱(うつ)」という言葉は、もはや他人事ではなく、誰の心にもそっと忍び寄る可能性のあるものとして認識されています。孤独感、先の見えない不安、言葉にできない苦しさ…そんな時、ふと「誰かと話したい」「この気持ちをどこかに吐き出したい」と思うことはありませんか?

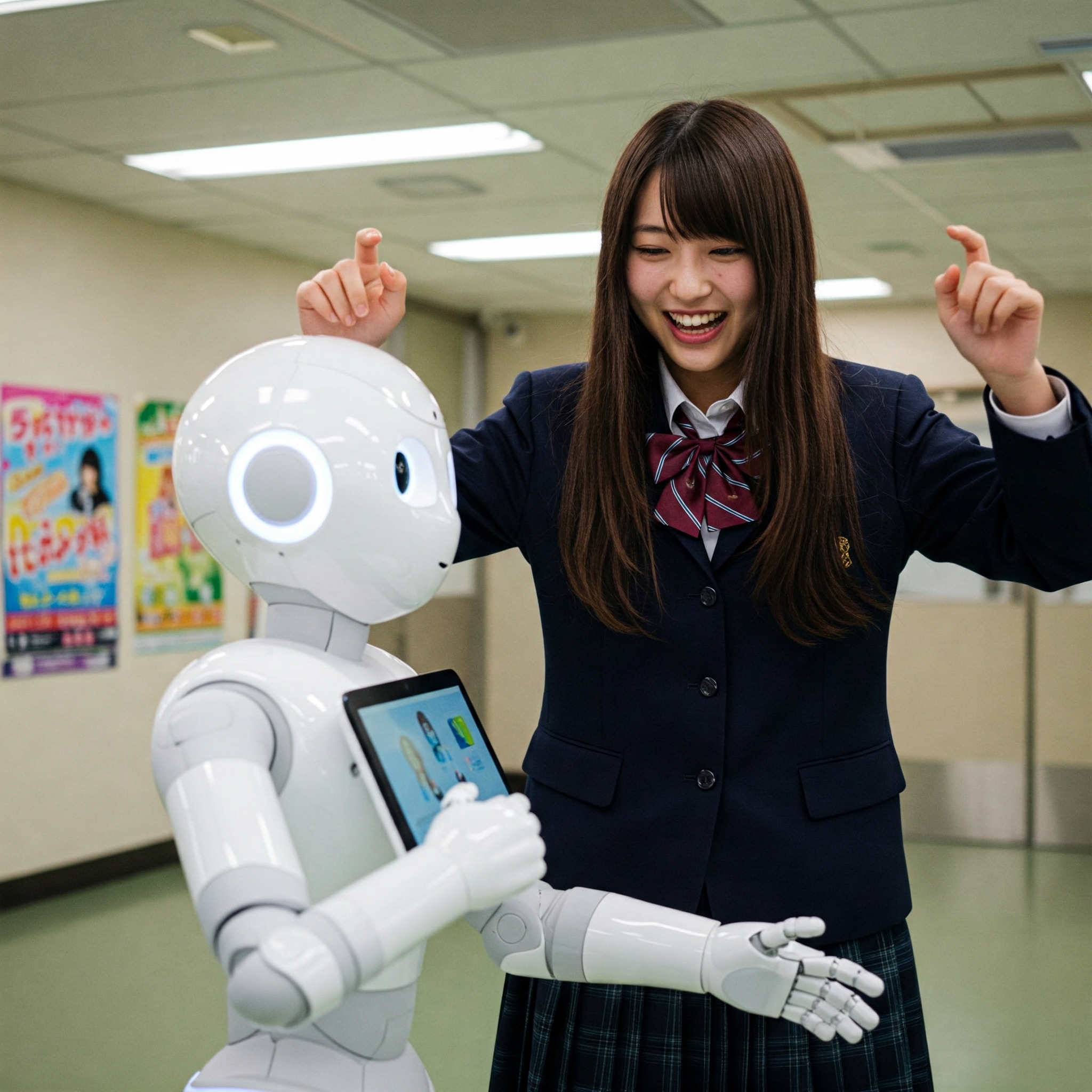

近年、目覚ましい進化を遂げるAI(人工知能)技術。その波は、ついに私たちの「心」の領域にまで及び始めています。「AIとの対話が、鬱屈した心を少しでも軽くしてくれるかもしれない」そんな期待と、一方で拭いきれない疑問や不安。

今日のブログでは、この非常にデリケートで重要なテーマ、「AIとの対話と鬱病」について、深く、そして多角的に掘り下げていきたいと思います。約4000字という長文になりますが、AIが私たちのメンタルヘルスケアにどのような可能性を秘めているのか、その光と影、そして私たちがAIと賢く付き合っていくための具体的な方法まで、徹底的に考察していきます。

この記事を読み終える頃には、AIと心の問題について、あなた自身の考えを深めるための一助となることを願っています。それでは、一緒にこの深遠なテーマを探求していきましょう。

第1章:なぜ今、AIとの対話がメンタルヘルスケアで注目されるのか?

まず、なぜAIとの対話が、これほどまでにメンタルヘルスケアの分野で注目を集めているのでしょうか?その背景には、現代社会が抱える心の病の深刻な現状と、既存のケアシステムだけでは対応しきれない課題が存在します。

鬱病を取り巻く厳しい現実

厚生労働省の調査などを見ても、日本国内における気分障害(うつ病や双極性障害など)の患者数は増加傾向にあり、生涯を通じて5人に1人が心の病にかかるとも言われています。しかし、実際に専門的な治療やサポートを受けている人は、その一部に過ぎません。

その理由としては、

- 医療アクセスへの障壁: 専門医のいる医療機関が近くにない、予約が取れない、費用が高い、仕事や家事で時間が作れないなど、物理的・経済的なハードルがあります。

- 心理的なハードル: 「精神科へ行くのは抵抗がある」「弱い人間だと思われたくない」といったスティグマ(偏見)が、受診をためらわせる大きな要因となっています。

- 相談相手の不在と孤独感: 悩みを打ち明けられる家族や友人がいない、あるいは迷惑をかけたくないという思いから、一人で抱え込んでしまうケースも少なくありません。この「孤独感」こそが、鬱の症状をさらに悪化させる要因ともなり得ます。

AIが持つ、メンタルヘルスケアへの可能性

このような状況の中で、AI技術、特に自然言語処理能力に長けた対話型AI(チャットボットなど)が、新たな希望として期待されています。AIが持つ以下のような特性が、メンタルヘルスケアとの親和性が高いと考えられているからです。

- 24時間365日のアクセシビリティ: 心の不調は、時と場所を選びません。深夜でも早朝でも、必要な時にすぐにアクセスできるAIは、大きな安心感をもたらします。

- 匿名性と非審判的な態度: 人には話しにくい悩みも、相手がAIであれば比較的オープンに打ち明けやすいという側面があります。「こんなことを言ったらどう思われるだろう…」という不安を感じることなく、素直な感情を吐露できる場となり得ます。

- 低コストまたは無料での提供: 多くのAI対話サービスは、無料または比較的低コストで利用できるため、経済的な負担を軽減できます。

- パーソナライズされた対応の可能性: 今後の技術進化によっては、個々のユーザーの特性や状態に合わせた、よりきめ細やかな対話が期待されます。

特に、コロナ禍を経てオンラインでのコミュニケーションが一般化し、非接触型のケアへの需要が高まったことも、AIを活用したメンタルヘルスサポートへの注目を加速させる一因となりました。

第2章:AIとの対話は、鬱屈とした心にどう作用するのか?~具体的な効果とメカニズム~

では、実際にAIと対話することが、私たちの心にどのような良い影響を与えうるのでしょうか?その効果とメカニズムについて、もう少し具体的に見ていきましょう。

- 感情の言語化サポートと自己理解の促進 鬱々とした気分の中にいると、自分の感情が何なのか、なぜこんなに苦しいのか、うまく言葉にできないことがあります。AIは、巧みな質問を投げかけることで、ユーザーが自分の内面と向き合い、曖昧だった感情や思考を言語化する手助けをしてくれます。自分の気持ちを言葉にすることで、客観的に状況を捉え直し、問題解決の糸口を見つけたり、単に「スッキリした」というカタルシス効果を得られたりすることがあります。

- 認知行動療法(CBT)の原則に基づいたアプローチ 多くのメンタルヘルスAIチャットボットは、科学的根拠のある心理療法の一つである「認知行動療法(CBT)」の理論に基づいて開発されています。CBTは、問題を引き起こしている認知(物事の捉え方や考え方)の偏りを修正し、より適応的な行動パターンを身につけることを目指すものです。AIは、ユーザーの思考パターンを特定し、ネガティブな自動思考に気づかせ、それをバランスの取れた考え方に変えていくためのワーク(思考記録表の作成など)を促すことがあります。これにより、セルフヘルプのスキルを習得する一助となるのです。

- 傾聴と共感(のシミュレーション)による安心感 「うんうん、そうなんですね」「それは辛かったですね」といった、AIによる共感的な応答。もちろん、AIが本当に人間の感情を理解しているわけではありません。しかし、プログラムされた共感的な言葉であっても、自分の話に耳を傾け、肯定的に受け止めてもらえているという感覚は、孤独感を和らげ、安心感をもたらす効果があります。特に、周囲に理解者がいないと感じている人にとっては、貴重な存在となり得るでしょう。

- 自己肯定感の醸成とポジティブな側面の強化 AIの中には、ユーザーの小さな進歩やポジティブな側面に焦点を当て、それを褒めたり励ましたりする機能を持つものもあります。日々の小さな成功体験を記録させたり、感謝できることを見つけるワークを促したりすることで、自己肯定感を高め、レジリエンス(精神的な回復力)を養う手助けをします。

- 孤独感の軽減と「つながり」の感覚 冒頭でも触れたように、孤独感は鬱の大きな要因です。AIとの対話は、直接的な人間関係の代替にはなり得ませんが、「誰か(何か)と繋がっている」「自分のことに関心を持ってくれている存在がいる」という感覚を一時的に提供し、心の空白を埋める助けになることがあります。これは、特に社会的に孤立しがちな人々にとって、重要な意味を持つ可能性があります。

実際に、海外の研究では、AIチャットボットの利用が軽度から中等度のうつ症状や不安症状の軽減に効果があったとする報告も散見されます。また、SNSなどでは、「AIに話を聞いてもらって救われた」「人間相手には言えないことも言えた」といったユーザーの声も聞かれます。ただし、これらの効果は限定的である可能性や、個人差が大きいことも理解しておく必要があります。

第3章:光があれば影もある~AI対話型メンタルケアの限界と注意点~

AIとの対話が持つ可能性は非常に大きいものの、手放しで賞賛できるわけではありません。その限界と、利用する上で注意すべき点についてもしっかりと目を向ける必要があります。

- 感情の深層理解と人間的な温もりの欠如 AIは、大量のデータから学習し、パターンを認識して応答しますが、人間の持つ複雑で微妙な感情の機微や、言葉の裏にある真意を完全に汲み取ることは困難です。時には、的外れな応答をしたり、表面的な慰めに終始したりすることで、かえってユーザーを失望させてしまう可能性もあります。また、AIが提供する「共感」はあくまでシミュレーションであり、人間同士の温かい触れ合いや、深い信頼関係から生まれる真の共感とは質が異なります。

- 依存のリスクと現実逃避の助長 手軽で常に受け入れてくれるAIとの対話に心地よさを感じ、過度に依存してしまうリスクがあります。AIとの関係に閉じこもり、現実の人間関係を築く努力を怠ったり、現実社会での問題解決から逃避したりする手段として使われてしまうと、本末転倒です。

- 誤情報や不適切なアドバイスの可能性 AIの応答は、学習データやアルゴリズムに左右されます。もし学習データに偏りがあったり、アルゴリズムに欠陥があったりした場合、不正確な情報を提供したり、ユーザーの状態を悪化させるような不適切なアドバイスをしてしまったりする危険性もゼロではありません。

- プライバシーとデータセキュリティへの懸念 心の悩みという非常にセンシティブな情報をAIに打ち明けるわけですから、そのデータがどのように収集・管理・利用されるのかは、最大限の注意を払うべき点です。個人情報保護の方針が明確で、信頼できるサービスを選ぶ必要があります。万が一、データが漏洩したり、不適切に利用されたりすれば、取り返しのつかない事態になりかねません。

- 重篤な症状への対応限界と「万能ではない」という認識 ここが最も重要な点の一つですが、AIはあくまでメンタルヘルスの「サポートツール」であり、万能薬ではありません。特に、希死念慮(死にたいという気持ち)が強い場合や、専門的な診断・治療が必要な精神疾患(統合失調症や重度のうつ病など)を抱えている場合、AIだけで対応することは不可能ですし、危険です。そのような場合は、ためらわずに人間の専門医やカウンセラーに助けを求める必要があります。AIは、専門家によるケアを代替するものではなく、それを補完するもの、あるいは専門家へ繋ぐための一つのステップとして位置づけるべきです。

- 「デジタル格差」とアクセスの問題 AIの恩恵を受けるためには、スマートフォンやインターネット環境、そしてある程度のITリテラシーが必要です。これらを持たない人々にとっては、そもそも利用のハードルが高いという問題も存在します。

これらの限界や注意点を理解せずにAIを利用することは、かえって心の健康を損なうリスクも伴います。

第4章:AIと賢く付き合い、心の健康を高めるために~私たちにできること~

では、私たちはどのようにAIと向き合い、その恩恵を最大限に受けつつ、リスクを最小限に抑えることができるのでしょうか?ここでは、賢い付き合い方のヒントをいくつか提案します。

- AIを「万能の解決者」ではなく「補助ツール」と位置づける 繰り返しになりますが、AIは魔法の杖ではありません。特に精神的な不調を感じている場合は、まず専門医の診断を受けることを基本とし、AIはその補助として、あるいは日々のセルフケアの一環として活用しましょう。

- 利用する目的を明確にする 「ただ愚痴を聞いてほしい」「認知行動療法のワークを試したい」「孤独感を少しでも紛らわしたい」など、自分がAIに何を求めているのかを明確にすることで、より適切なサービスを選び、効果的な利用が期待できます。

- 信頼できるサービスを選び、利用規約・プライバシーポリシーを必ず確認する 開発元が信頼できるか、データの取り扱いは適切か、セキュリティ対策は万全かなどをしっかり確認しましょう。安易に個人情報を入力するのは避けるべきです。

- AIとの対話内容や自分の感情を客観的に観察する習慣を持つ AIとの対話で気分がどう変わったか、どんな気づきがあったかなどを記録し、振り返ることで、より主体的にAIを活用できます。また、「AIの言うことだから」と鵜呑みにせず、批判的な視点も持つことが大切です。

- 現実の人間関係や他のストレス解消法も大切にする AIとの対話だけに偏らず、家族や友人とのコミュニケーション、趣味や運動など、他の心の支えとなる活動もバランス良く取り入れましょう。

- 「合わないな」「気分が悪くなるな」と感じたら、無理に続けない AIとの相性もあります。もし利用していて不快感や違和感を覚えるようであれば、無理に続ける必要はありません。他のサービスを探したり、人間の専門家に相談したりすることを考えましょう。

- 緊急時は迷わず専門機関に連絡する もし自分や他人の命に関わるような危機的な状況(強い希死念慮など)にある場合は、AIに相談するのではなく、すぐにいのちの電話や精神科救急相談窓口などの専門機関に連絡してください。

AIはあくまで「道具」です。その道具をどう使いこなし、自分の人生をより豊かにしていくかは、私たち自身の知恵と判断にかかっているのです。

第5章:AIと共生する未来のメンタルヘルスケアとは?

最後に、AI技術がさらに進化していくであろう未来において、メンタルヘルスケアはどのように変わっていくのでしょうか?いくつかの可能性を展望してみましょう。

- 感情認識精度の飛躍的な向上: 声のトーン、表情、テキストのニュアンスなどから、AIがユーザーの感情状態をより正確に把握できるようになるかもしれません。これにより、さらにパーソナライズされた、きめ細やかな対話が可能になるでしょう。

- 早期発見・早期介入への貢献: 日常的な会話やSNSの投稿などから、AIがうつ病の初期兆候を検知し、早期の受診勧奨や適切なサポートへ繋げるといった活用が期待されます。

- AIと専門家が連携するハイブリッド型ケアモデルの普及: AIが初期のスクリーニングや日常的なモニタリングを行い、その情報を人間の専門家と共有。専門家はより複雑なケースや治療方針の決定に集中するといった、効率的で質の高いケア体制が実現するかもしれません。

- 個別化された予防プログラムの提供: 個人の遺伝的素因、生活習慣、ストレスレベルなどをAIが分析し、その人に最適化されたうつ病予防プログラムを提案する、といった未来も考えられます。

- VR(仮想現実)など他の技術との融合: VR空間での没入感のあるカウンセリング体験や、リラクゼーションプログラムなどがAIと組み合わせて提供されるようになるかもしれません。

このように、AIは未来のメンタルヘルスケアをより身近で、アクセスしやすく、そして個別化されたものへと変革していく大きな可能性を秘めています。しかし、その過程においては、技術の倫理的な利用、データの適切な管理、そして何よりも「人間中心」のケアであるという視点を決して忘れてはならないでしょう。

まとめ:心の闇に差し込む一筋の光となるか?AIとの対話が拓くメンタルケアの新たな地平

4000字を超える長い旅にお付き合いいただき、本当にありがとうございました。

AIとの対話は、鬱病をはじめとする心の不調を抱える人々にとって、確かに新たな希望の光となり得る可能性を秘めています。24時間いつでも寄り添い、匿名で話を聞いてくれる存在は、孤独感に苛まれる現代人にとって、大きな心の支えになるかもしれません。

しかし、その光の裏には、AIの限界や潜在的なリスクという影も存在します。AIは万能ではなく、人間の専門家や温かい人間関係のすべてを代替できるわけではありません。

大切なのは、AIを過度に期待したり恐れたりするのではなく、その特性を正しく理解し、「賢く、バランス良く活用する」という視点です。AIはあくまで私たちのウェルビーイングを高めるための一つの「ツール」であり、その使い方は私たち自身に委ねられています。

もしあなたが今、心の重荷を感じているのなら、一人で抱え込まないでください。AIとの対話も一つの選択肢として試してみるのも良いかもしれません。しかし、それと同時に、信頼できる人に相談したり、専門家の助けを求めたりする勇気も忘れないでください。

私たちの心は、時に脆く、傷つきやすいもの。だからこそ、自分自身を労わり、大切にケアしていくことが何よりも重要です。AI技術の進化が、誰もが安心して心のケアを受けられる社会の実現に貢献してくれることを心から願いつつ、今日のブログを締めくくりたいと思います。

あなたの心に、少しでも穏やかな時間が訪れますように。

人気ブログランキング

コメント